O desafio

por Lee Alan Evans, Ki-Hwan G. Bae e Arnab Roy (Universidade de Louisville)

Conforme apresentado na Conferência de Simulação de Inverno de 2017

Um modelo de simulação de eventos discretos é desenvolvido para representar um sistema de avaliação de desempenho de distribuição forçada, incorporando a estrutura, a dinâmica do sistema e o comportamento humano associados a esses sistemas. O objetivo deste estudo é analisar o comportamento humano e explorar um método de validação de modelo que capture a função da senioridade do subordinado no processo de avaliação. Este estudo inclui experimentos de simulação que mapeiam as funções de caixa preta que representam o comportamento humano para os resultados da simulação. A eficácia de cada função comportamental baseia-se em uma função de resposta com vários objetivos, que é uma função de soma de erros ao quadrado que mede a diferença entre os resultados do modelo e os dados históricos. Os resultados dos experimentos demonstram a utilidade da aplicação de técnicas de otimização de simulação à fase de validação do modelo do projeto do sistema de simulação.

Histórico

O Exército dos Estados Unidos utilizou diversas técnicas para reduzir o número de militares na ativa de mais de 566.000 em 2010 para menos de 470.000 em 2016. Essas técnicas incluíam conselhos de separação involuntária, conselhos de aposentadoria antecipada, diminuição de adesões, diminuição de oportunidades de alistamento e diminuição das taxas de promoção. O ponto central de cada um dessesmecanismos de formação de força, com exceção da redução de adesões, foi a análise das avaliações de desempenho.

As avaliações de desempenho são de grande importância nas fileiras de oficiais devido à Lei de Gerenciamento de Pessoal de Oficiais de Defesa de 1980 (DOPMA). Essa lei, aprovada pelo Congresso em 12 de dezembro de 1980, determina o número de oficiais em função do nível geral de força de pessoal do Exército, mas, o que é mais importante, ela codifica osistema de promoção up-or-out(Rostker et al. 1993). Osistema de promoção ascendente ou descendentefoi projetado de forma que os oficiais sejam avaliados por conselhos de promoção e, se selecionados, avancem nas fileiras em coortes, geralmente determinadas pelos anos de serviço como oficial. Além disso, qualquer oficial que for preterido duas vezes na promoção para o próximo posto é obrigado a deixar o serviço. A única exceção ao mandato de separação é uma cláusula que permite acontinuação seletivapara oficiais selecionados, com a intenção de que seja usada com moderação. Osistema de promoção "up-or-out"facilita a estrutura de postos mostrada na Figura 1, que também foi estabelecida no DOPMA.

Uma das patentes mais afetadas pela redução foi a de tenente-coronel, que passou de uma taxa de promoção de mais de 91% em 2006 para uma taxa de promoção de apenas 60,2% em 2016. Uma análise dos resultados do conselho de promoção mostra que os percentis identificados nas avaliações são o melhor indicador de que um oficial foi promovido. O sistema de avaliação de desempenho de oficiais do Exército dos Estados Unidos é um sistema de distribuição forçada que usa uma comparação relativa de oficiais em um conjunto de avaliações e força os avaliadores a dar avaliações máximas a menos de 49% de seus subordinados (Department of the Army Headquarters, 2015). Uma análise mais aprofundada dos resultados do conselho de promoção mostra que a antiguidade desempenha um papel significativo no fato de um oficial receber ou não uma avaliação superior. No entanto, a função usada pelos avaliadores para classificar e avaliar os subordinados é desconhecida (caixa preta) e ruidosa devido à priorização individual da antiguidade pelos avaliadores.

Literatura relacionada

Para fins deste projeto de sistema de simulação, analisamos métodos de planejamento de mão de obra, sistemas de avaliação de desempenho, gerenciamento de talentos, otimização de simulação e validação de modelos.

Bartholomew, Forbes e McClean (1991) definemo planejamento de mão de obracomo "a tentativa de combinar a oferta de pessoas com os empregos disponíveis para elas". Wang (2005) classifica as técnicas de pesquisa operacional aplicadas ao planejamento de mão de obra em quatro ramos: modelos de otimização, modelos de cadeia de Markov, modelos de simulação por computador e gerenciamento da cadeia de suprimentos por meio da dinâmica do sistema. Hall (2009) observa que a literatura existente sobre planejamento de mão de obra se enquadra em um dos três tópicos principais: programação dinâmica, modelos markovianos e programação de metas. Embora as listas não sejam exaustivas nem mutuamente exclusivas, classificamos as técnicas existentes nas categorias de modelos de otimização, Markov e simulação.

Os primeiros exemplos de modelos de otimização incluem modelos de programação dinâmica que fornecem uma estrutura para a tomada de decisões sobre recursos humanos (Dailey 1958, Fisher e Morton 1968). Um aplicativo de programação dinâmica mais recente é o de Ozdemir (2013), que fornece uma ordem de processamento de hierarquia analítica para a seleção de pessoal. Bres et al. (1980) e Bastian et al. (2015) fornecem modelos de programação de metas para analisar a força de oficiais e a combinação ocupacional em um horizonte de tempo finito. Kinstler et al. (2008) usam um modelo markoviano para o Corpo de Enfermagem da Marinha dos EUA para determinar o número ideal de novos recrutas a fim de resolver o problema de excesso de pessoal nos escalões inferiores para atender aos requisitos dos escalões superiores. Embora os modelos de Markov possam ser usados como modelos autônomos, eles são mais comumente incorporados a modelos de otimização maiores (Hall 2009, Zais 2014). Lesinski et al. (2011) e McGinnis, Kays e Slaten (1994) são exemplos de simulação usada para modelagem de mão de obra. A construção da simulação desenvolvida por Lesinski et al. (2011) foi usada para determinar se o momento e a duração do treinamento inicial de oficiais apoiavam um novo modelo de prontidão da unidade do Exército. Da mesma forma, o modelo de simulação de eventos discretos de McGinnis, Kays e Slaten (1994) analisa a viabilidade das políticas de pessoal propostas que exigem um período mínimo de tempo em atribuições importantes. O que é pertinente a todos os métodos existentes é que eles se concentram em atender aos requisitos de forma agregada. Ou seja, os modelos estimam os requisitos de acesso e entrada lateral com base no histórico de atritos, promoções e crescimento previsto. Pouca atenção é dada à modelagem dos sistemas que identificam e selecionam os indivíduos mais qualificados para preencher os requisitos, em vez da medida binária de se um cargo está ocupado ou vago.

Wardynski, Lyle e Colarusso (2010) definem o talento dos oficiais do Exército dos EUA como a interseção de conhecimentos, habilidades e comportamentos individuais. Dabkowski et al. (2010) observam que a medição do talento dos oficiais é em grande parte conceitual, mas as medições reais não são necessárias para analisar os impactos das políticas sobre a retenção de talentos. Seu modelo usa uma pontuação de talento normalmente distribuída para analisar o impacto de vários padrões de atrito sobre o talento da liderança sênior. Wardynski, Lyle e Colarusso (2010) demonstram que as fontes de comissionamento com os requisitos de triagem mais rigorosos produzem oficiais com melhor desempenho nos escalões superiores, o que dá credibilidade ao tratamento dado por Dabkowski et al. (2010) ao talento como um valor estático e inato.

Sabe-se que os sistemas de avaliação de desempenho têm tendências e erros inerentes. É difícil quantificar exemplos de parcialidade e erro nos sistemas de avaliação de desempenho, mas eles incluem os avaliadores avaliam de forma mais generosa (clemência) ou mais severa (severidade) do que os subordinados merecem, os avaliadores formam opiniões positivas (halo) ou negativas (chifre) em torno de um número limitado de critérios, o desempenho recente tem um peso maior (recência), os avaliadores elevam a classificação do subordinado para parecerem melhores (interesse próprio) e classificam os subordinados em relação uns aos outros em vez de aos padrões de desempenho (contraste/similaridade) (Coens e Jenkins 2000, Carroll e Schneier 1982, Kozlowski, Chao e Morrison 1998). O físico e matemático W. Edwards Deming acrescenta que o resultado do desempenho individual depende da estrutura de um sistema (Elmuti, Kathawala e Wayland 1992). Os resultados da avaliação de desempenho dependem da mesma forma da estrutura do sistema. A imprecisão em um sistema de avaliação de desempenho refere-se à extensão em que o resultado da avaliação difere da verdadeira distribuição dos níveis de desempenho em um grupo de funcionários avaliados (Carroll e Schneier 1982).

A validação de um modelo de simulação com o objetivo de estimar a imprecisão em um sistema de avaliação de desempenho é uma tarefa nada trivial. Law (2015) afirma que "o teste mais definitivo da validade de um modelo de simulação é estabelecer que seus dados de saída se assemelham muito aos dados de saída que seriam esperados do sistema real". Existem vários métodos para validação de modelos. Balci (1998) lista 75 técnicas para verificação, validação e teste de modelos, mas observa que a maioria dos profissionais usa técnicas informais que dependem do raciocínio e da subjetividade humana.

Declaração do problema

Kane (2012) observa que as avaliações geralmente estão vinculadas ao cargo, e não estritamente ao desempenho. Isso é mais comum em filiais que têm cargosimportantes de desenvolvimento. Para atenuar o efeito das atribuições dos oficiais que influenciam a classificação atribuída, usamos dados estritamente para majores de áreas funcionais com homogeneidade de atribuições. Uma área funcional é um "agrupamento de oficiais por especialidade técnica ou habilidades que não sejam de um braço, serviço ou ramo que geralmente requer educação, treinamento e experiência exclusivos", de acordo com o Quartel-General do Departamento do Exército (2014).

Os oficiais recebem avaliações a cada designação, nas quais são classificados em relação a seus pares, ou oficiais da mesma patente. A Figura 2 mostra o fluxograma típico de um oficial do Exército dos EUA. Os oficiais entram no sistema de avaliação e são designados para um grupo de seus pares, conhecido comopool de classificação. Em geral, cada oficial recebe uma avaliação anual com base em seu desempenho em relação aos outros oficiais do mesmo grupo de classificação. Após a avaliação, o funcionário permanece no mesmo grupo ou é transferido para um grupo diferente. Normalmente, a transferência envolve uma mudança física de localização geográfica. Depois que o funcionário passa um determinado tempo no sistema, cinco anos no caso da Figura 1, ele sai do sistema. O arquivo do oficial é apresentado a um conselho de promoção, composto por oficiais generais, que decidem se o oficial continua no posto sucessivo ou se é forçado a deixar o serviço militar.

Os avaliadores são impedidos de dar a mais de 49% dos oficiais em seu grupo uma avaliação máxima. A intenção desse mandato de distribuição forçada é fornecer uma diferenciação de desempenho para as decisões de gerenciamento de pessoal. Os sistemas de avaliação de desempenho de distribuição forçada aplicados a um pequeno número de funcionários geram identificação errônea do desempenho. Mohrman, Resnick-West e Lawler (1989) afirmam que os sistemas de distribuição forçada só devem ser aplicados a um grupo suficientemente grande de indivíduos, especificamente não menos que 50 funcionários. A distribuição binomial fornece alguns insights quando se tenta quantificar essa identificação incorreta do desempenho. Se Xforuma variável aleatória que denota o número de 49% dos melhores funcionários em um grupo de classificação den funcionários, e o desempenho dos funcionários for independente, então XsegueBinomial(n, 0,49). Os erros de identificação ocorrem quando o número de oficiais que merecem as melhores avaliações excede a restrição de perfil. Por exemplo, sen = 15, E[Misidentifications] é ∑15, x=8 P(X= x)(x -7) = 0,9470.Quandon = 100, E[Misidentifications] é ∑100, x=50 P(X= x)(x -49) = 1,9893. Portanto, se uma população de 300 policiais for dividida em 20 grupos de classificação, esperaríamos 18,9405 (0,9470 x 20) identificações errôneas. Os mesmos 300 oficiais divididos em três grupos de classificação resultam em 5,9680 (1,9893 x 3) erros de identificação esperados. Outros fatores que afetam a precisão das avaliações são a distribuição dos tamanhos dos grupos de classificação, a frequência das mudanças entre os grupos de classificação e o comportamento humano dentro do sistema. Esses fatores, aplicados em um período de vários anos, exigem o uso de técnicas como a simulação para quantificar o erro induzido por um sistema de avaliação de desempenho de distribuição forçada.

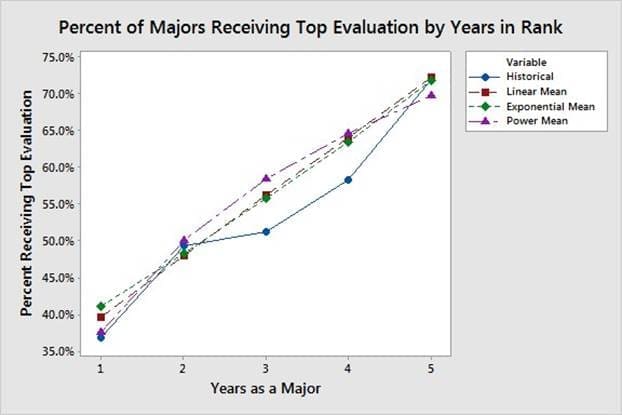

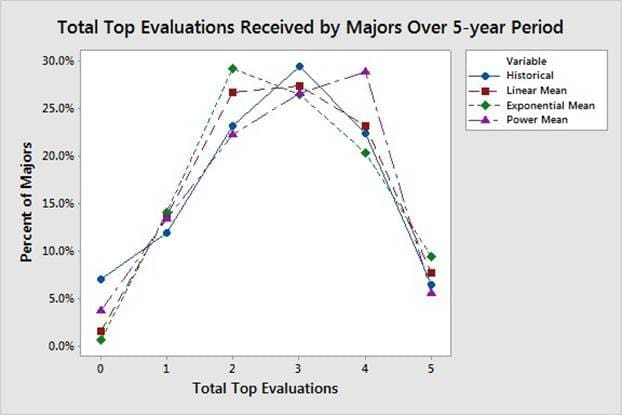

A quantificação do comportamento do avaliador na classificação e na avaliação dos subordinados requer a aplicação de métodos avançados de validação de modelos. A Figura 3 mostra que os oficiais têm maior probabilidade de receber uma avaliação superior à medida que aumenta seu tempo na hierarquia. A Figura 4 mostra a distribuição do número de avaliações máximas que os majores recebem em um período de cinco anos. O resultado da simulação correspondente às distribuições mostradas na Figura 3 e na Figura 4 está sujeito à função do avaliador usada para classificar e avaliar os subordinados dentro de cada grupo de classificação, ou seja, uma função de caixa preta. Os dados mostrados na Figura 3 e na Figura 4 são de majores que enfrentaram conselhos de promoção em 2015 e 2016, que tiveram taxas de promoção de 60,4% e 60,2%, respectivamente. A base para a comparação do modelo é uma média desses dois anos devido à sua semelhança e para concentrar o modelo nas tendências atuais de avaliação.

A contribuição de nosso estudo é examinar um método para estimar essa função de caixa preta usando otimização de simulação. Criamos um modelo de simulação de eventos discretos e modificamos a função de classificação usada para simular o comportamento humano usando o OptQuest e o procedimento Kim-Nelson (KN), um método de otimização de simulação de seleção e classificação totalmente sequencial. Os parâmetros de várias funções são avaliados para determinar sua adequação para replicar o comportamento do avaliador.

Para avaliar o resultado, usamos uma adaptação da função de custoJ(θ) que Ikonen e Najim (2002) apresentaram na forma geral:

A função de custo quadrático da Equação (1) atribui pesos αkàs diferenças quadráticas entreKresultadosobservados,y(k), e as previsões do modelo, θTϕ(k). O objetivo é minimizar a função de custoJ comrelação aos parâmetros θ, como na Equação (2):

A Seção 4 detalha a derivação da função de custo e os parâmetros do sistema.

A solução

Descrição do modelo

Entrada do modelo e dinâmica do sistema

O modelo de simulação foi desenvolvido no Simio e segue a estrutura da Figura 2. Os policiais entram no sistema em uma taxa uniforme e recebem um atributoQique representa o percentil de desempenho inicial do policial, sendoQiUniform(0,1). Os policiais são distribuídos aleatoriamente em grupos de classificação. Anualmente, os dirigentes são classificados e recebem uma avaliação,Xi jonde:

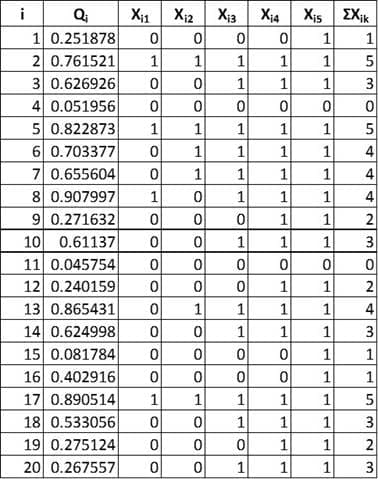

Após cada avaliação, o funcionário muda de grupo de classificação com probabilidadep oupermanece no mesmo grupo de classificação com probabilidade 1 -p, simulando a dinâmica do sistema de funcionários que mudam de grupo de classificação regularmente. A variação do valor dep alteraa quantidade média de tempo que os oficiais passam em cada grupo. Ump = 0,730 corresponde a uma média de 16,42 meses em cada posição, o tempo médio na posição para oficiais que enfrentaram conselhos de promoção em 2015 e 2016. Após cinco anos de coleta de avaliações, os oficiais saem do sistema e seu histórico binário de avaliação de desempenho é registrado em um arquivo de saída. Um arquivo de saída de simulação truncado é mostrado na Figura 5.

Funções de classificação

Considerando as tendências dos dados na Figura 3, a propensão dos avaliadores a conceder uma avaliação superior aumenta à medida que os oficiais que estão avaliando aumentam em antiguidade. Portanto, o procedimento usado para classificar os oficiais usa uma combinação do percentil de desempenho inicial com uma função do tempo no sistema. Anotamos isso como

Qti, em que Qti(Qi,t,α),t éo tempo (anos) do policial no sistema e αé um parâmetro estimado usado para aplicar um peso ao tempo do policial no sistema. Considerando o comportamento do avaliador, analisamos a qualidade do ajuste

para as seguintes funções crescentes:

Linear:Qti=Qi+ αt(3)

Exponencial:Qti=Qi+ αt(4)

Potência:Qti=Qi+ tα(5)

Saída

A Figura 5 mostra o resultado da simulação para uma determinada função de classificação. A análise de cada função de classificação consiste em sua capacidade de replicar os dados reais mostrados nas Figuras 3 e 4. Antes de otimizar os parâmetros de cada função de classificação, é necessário determinar um domínio razoável para α. Para a Equação (3),

Um α= 0 significa que a determinação da classificação do avaliador dentro do conjunto de classificações baseia-se apenas no percentil de desempenho do policial ao entrar no sistema, e o tempo no sistema não é um fator. Da mesma forma, um α= 0,4 significa que o tempo do policial no sistema é, no mínimo, 0,4 vezes mais importante que oQiquandot = 1 e, no mínimo, duas vezes mais importante que oQiquandot = 5 na determinação da classificação em um determinado grupo de classificação. Portanto, avaliaremos 0< α< 0,4 ao otimizar o resultado da Equação (3).

A eficácia da Equação (4) também pode ser avaliada usando limites semelhantes para α. Entretanto, na Equação (4), 0< α<1 cria uma função decrescente com relação ao tempo no sistema. Além disso, para que o tempo do policial no sistema tenha um mínimo de duas vezes o peso deQina determinação da classificação em um determinado conjunto de classificações para a Equação (4) quandot = 5, α1,148. Portanto, limitamos o domínio de αpara a Equação (4) a 1< α<1,148. Da mesma forma, limitamos αna Equação (5) a 0< α< 0,431.

Estimativa de parâmetros

Função de resposta

Para otimizar o resultado da simulação, usamos uma forma da função de resposta multiobjetivo introduzida por Ikonen e Najim (2002). O problema é formulado como:

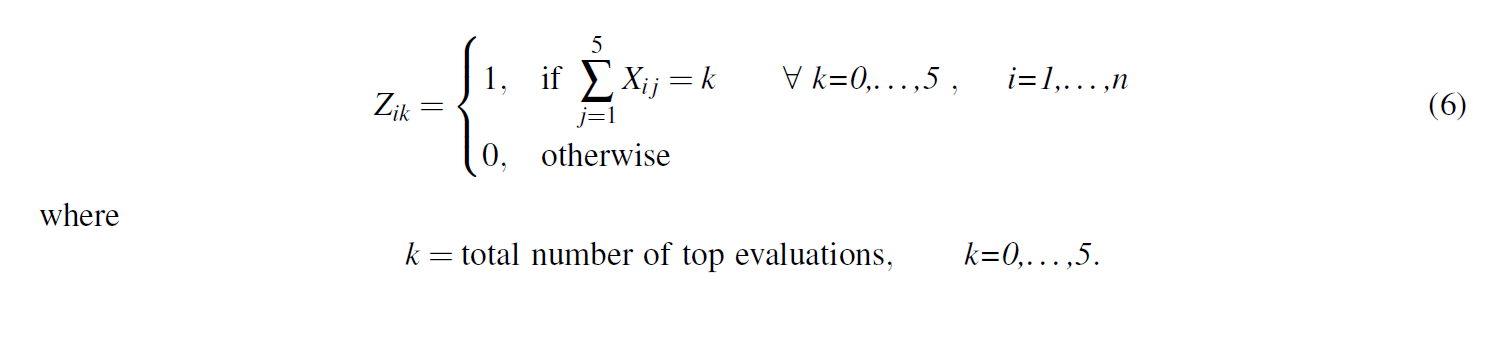

A variável bináriaZikna Equação (6) é usada para identificar se cada executivo(i) recebeu 0,1, . . .,5 avaliações superiores durante o período de 5 anos no sistema. A Equação (7) mede a diferença ao quadrado entre a porcentagem de funcionários da simulação comkavaliaçõesprincipaiseAk, em que a variávelAké a porcentagem histórica de funcionários que receberamkavaliaçõesprincipais. Esse erro quadrático é calculado para cada valor dek esomado na equação:

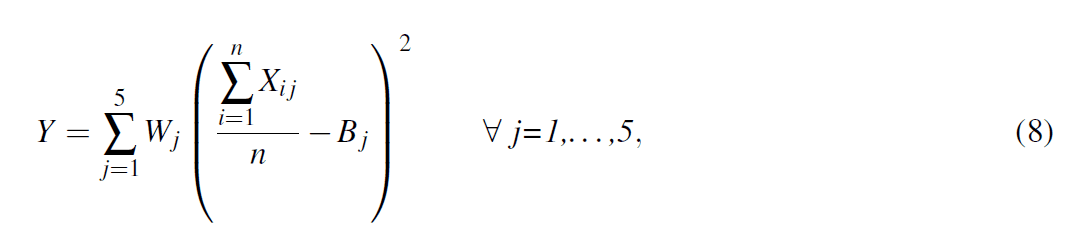

A equação (7) mede a qualidade do ajuste do resultado da simulação em comparação com os dados mostrados na Figura 4. O número total de avaliações superiores recebidas por cada oficial é uma medida da precisão do modelo. Outra medida de precisão é o tempo das melhores avaliações que cada policial recebe. Esse erro quadrático é calculado para cada anoj esomado na equação:

ondeB jé a porcentagem de oficiais com uma avaliação máxima no anoj. Os pesos,Wkna Equação (7) eWjna Equação (8), nos permitem controlar os pesos das diferenças entre cada resultado da simulação e os dados reais. Isso permite compensar as diferenças no erro relativo, bem como o número desigual de pontos de dados na Equação (7) em relação à Equação (8). O valorY naEquação (8) mede a qualidade do ajuste do resultado da simulação em comparação com os dados mostrados na Figura 3. As medidas de eficácia fornecidas nas Equações (7) e (8) podem ser combinadas em uma única medida de desempenho ponderada

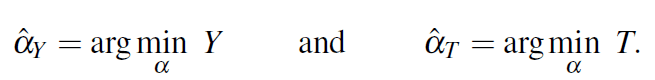

ponderada,D =T +Y . Então, o problema passa a ser encontrar o valor do parâmetro da função de classificação de αque minimiza a função objetivaD. Ou seja, αˆ= arg minD.

α

O impacto nos negócios

Estimativa de parâmetro de objetivo único

Para estimar os parâmetros da função de classificação, utilizamos a rotina de otimização de simulação OptQuest (April, Glover e Kelly 2002). O usuário pode modificar o número mínimo e máximo de replicações para uma configuração de erro relativo específica, juntamente com o número máximo de cenários. Os resultados da rotina OptQuest fornecem a lista de soluções candidatas iniciais avaliadas pelo método KN, um procedimento totalmente sequencial que elimina soluções estatisticamente inferiores após cada replicação. Executamos o procedimento KN com uma zona de indiferença de 0,001 nos melhores cenários de subconjunto da rotina OptQuest para determinar a configuração ideal do parâmetro αem cada função de classificação. Uma discussão detalhada sobre o procedimento KN pode ser encontrada em Kim e Nelson (2001). Usando o suplemento Simio OptQuest, 50 cenários, com 10 replicações cada, levaram entre 15 e 16 minutos para serem executados em um Intel@ Core i5-4300U a 2,50 GHz com 8,00 GB de RAM.

Para a estimativa de parâmetros de objetivo único, realizamos dois experimentos separados para encontrar os parâmetros de cada função de classificação que foi resolvida:

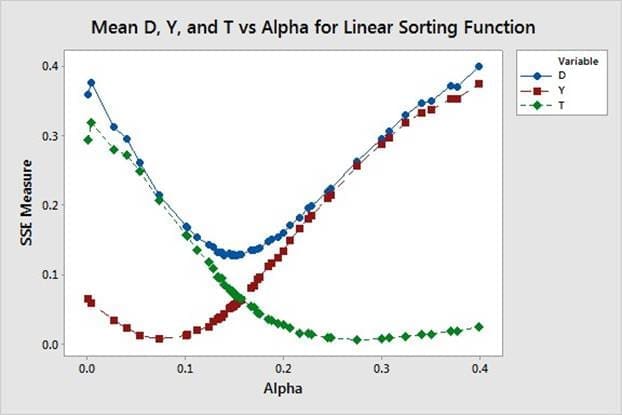

Na Equação (8),Bj =[0,368, 0,493, 0,512, 0,582, 0,719], que representa a porcentagem de majores que estão sendo promovidos em 2015 e 2016 e que receberam uma avaliação superior a cada ano na classificação. O parâmetro αfoi avaliado nas Equações (3), (4) e (5), e oYmínimoparacada função de classificação é mostrado na Figura 6.

Considerando queWj =[1,1,1,1, 1,1], a Tabela 1 resume o desempenho de cada função de classificação com as configurações ideais dos parâmetros. Cada função de classificação é comparada com a melhor na coluna "Percent Gap" da Tabela 1.

Tabela 1: Um resumo doYmínimoparacada função de classificação com αdeterminado pela otimização da simulação.

|

Função de classificação |

Y mínimo | Lacuna percentual |

|

Linear |

0.00674 | 1.81% |

|

Exponencial |

0.00662 | - |

|

Potência |

0.00985 | 48.79% |

O parâmetro αtambém foi avaliado nas Equações (3), (4) e (5) e o T mínimo para cada função de classificação é mostrado na Figura 7. Na Equação (7),Ak =[0,070, 0,119, 0,231, 0,294, 0,223, 0,064], que representa as porcentagens históricas de oficiais que enfrentaram promoção em 2015 e 2016 e que receberam [0, 1,...,5] avaliações máximas totais como major. Considerando queWk=[1,1,1,1,1, 1,1], o T mínimo para cada função de classificação e uma comparação de cada função de classificação com a melhor são mostrados na Tabela 2.

Tabela 2: Um resumo doTmínimoparacada função de classificação com αdeterminado pela otimização da simulação.

|

Função de classificação |

T mínimo | Lacuna percentual |

|

Linear |

0.0138 | - |

|

Exponencial |

0.0275 | 99.27% |

|

Potência |

0.0175 | 26.81% |

Estimativa ponderada de parâmetros multiobjetivos

Na estimativa de parâmetro de objetivo único, usamos equações separadas para cada função de classificação ao determinar o mínimo deT eY . Para a estimativa de parâmetro multiobjetivo, usamos uma soma ponderada deY eT . Portanto, é necessário determinarWj eWk apropriadospara afunção de resposta,D. A Equação (8) soma o erro quadrático entre seis saídas de simulação e os dados históricos, enquanto a Equação (7) soma o erro quadrático entre cinco pontos de dados e os dados históricos. Portanto, começamos definindo cada componente deWkcomo5/6 para ponderar os resultados deT eY igualmente. Por fim, consideramos o erro relativo em Wk. O valor médio das respostas usadas na Equação (7) é 0,535, representando a porcentagem média de majores que recebem uma avaliação máxima em um determinado ano. O valor médio das respostas usadas na Equação (8) é 0,167, representando a porcentagem média de majores que recebem cada uma das seis possibilidades para um número total de avaliações de alto nível. Compensamos a diferença de magnitudes multiplicando oWk inicialpor3,21 (0,535/0,167) e cada componente do vetorWké2,675 (3,21 5/6). Portanto, ao avaliarD, usamosWj =[1,1,1,1,1] eWk=[2,675,2,675,2,675,2,675,2,675,2,675,2,675]. A Figura 8 mostra que a minimização deDnão minimizaY ouT .

A eficácia de nossa abordagem multiobjetivo ponderada é ilustrada nos dois gráficos da Figura 9. A linha denominada "No Time Factor" representa um nível de desempenho estático sem fator de tempo adicional, resultando emD = 0,864. A compensação entreT eY mostradana Figura 8 resulta em uma melhoria percentual reduzida das respostas de estimativa de parâmetro de objetivo único resumidas nas Tabelas 1 e 2. A Tabela 3 mostra o valor de D usando as configurações de parâmetros ideais para cada uma das três funções de classificação.

Tabela 3: Um resumo doDmínimoparacada função de classificação com αdeterminado pela otimização da simulação.

Conclusões

As funções de classificação avaliadas nos experimentos descritos anteriormente representam um aumento no nível de desempenho percebido em função do tempo. Isso pode ser uma melhoria real no desempenho, a tendência do avaliador de recompensar a senioridade ou uma combinação dos dois. As funções avaliadas não são uma lista exaustiva de possibilidades, mas representam um conjunto facilmente interpretável com limites superior e inferior claros para o parâmetro α, que demonstra o efeito da senioridade no processo de avaliação. O objetivo do resultado do modelo determina a função de classificação mais adequada: uma função de classificação exponencial para minimizarY, uma função de classificação linear para minimizarT ou uma função de classificação de potência para minimizarD. Pesquisas futuras explorarão o uso de polinômios de ordem superior para representar melhor o comportamento humano no modelo. A quantificação do efeito da antiguidade no processo de avaliação ajudará os profissionais de recursos humanos a determinar até que ponto as avaliações de desempenho representam os níveis reais de desempenho dos oficiais em relação a seus pares.

AGRADECIMENTOS

Esta pesquisa foi parcialmente financiada pela Omar Nelson Bradley Foundation. As opiniões expressas neste artigo são de responsabilidade dos autores e não refletem necessariamente a política ou a posição oficial do Comando de Recursos Humanos do Exército dos Estados Unidos, do Departamento do Exército, do Departamento de Defesa ou do Governo dos EUA.

Applications

- Simulação da triagem de pacientes em um departamento de medicina interna para validar o uso de um índice de carga de trabalho baseado em otimização

- Simulação do lançamento de produção do L3Harris TR3

- Simulação da interrupção do tráfego marítimo em pontos de estrangulamento na cadeia de abastecimento alimentar global