Die Herausforderung

von Theodore T. Allen und Enhao Liu (The Ohio State University)

Vorgestellt auf der Winter Simulation Conference 2018

In diesem Artikel wird ein diskretes Ereignissimulationsmodell einer Organisation vorgeschlagen, die Computer-Hosts unterhält und mehrere Millionen Dollar an Wartungs- und Störungsbeseitigungskosten verursacht. Die übliche Wartungspolitik wird als "out-of-sight is out-of-mind" (OSOM) bezeichnet, da die meisten Hosts bei Scans nicht auftauchen und ignoriert werden. Hosts sind "dunkel" (abwesend), weil sie nicht zugänglich sind (ausgeschaltet oder mit eingeschränkten Rechten). Das vorgeschlagene Modell wird verwendet, um OSOM mit Alternativen zu vergleichen, einschließlich verbesserter Analyseverfahren, die Schwachstellen von Dark Hosts sichtbar machen. Die Ergebnisse verdeutlichen die offensichtlichen Vorteile von OSOM, sofern keine indirekten Kosten für Einbrüche oder verbesserte Richtlinien anfallen. Außerdem werden die Vorteile der Verwendung von Windows-Betriebssystemen und verbesserten Richtlinien verdeutlicht, einschließlich erwarteter Einsparungen in Millionenhöhe (im Vergleich zu Linux).

Einführung

Kosten im Zusammenhang mit der Cybersicherheit sind auf mehreren Ebenen von Bedeutung, von der nationalen und internationalen Politik über Stromnetze, die Tausende von Unternehmen miteinander verbinden, bis hin zu Ausgaben innerhalb einzelner Unternehmen. Diskrete Ereignismodelle haben die politischen Auswirkungen untersucht (Naugle et al. 2016). Zu den Modellen auf der Ebene der Stromnetze gehören die von Nguyen et al. (2015) beschriebenen. Zu den Angriffssimulationsmodellen gehören auch Shinet al. (2015) und Case (2016).

In unserer eigenen Forschung haben wir Markov-Entscheidungsprozessmodelle für organisatorische Ausgaben untersucht, die sich auf die Entwicklung einzelner Hosts konzentrieren (Afful-Dadzie und Allen 2014; 2016). Computer-Hosts können gewöhnliche PCs, Laptops, Server, Drucker oder sogar Trainingsgeräte sein. Hier konzentrieren wir uns nur auf Geräte, die mit dem Internet verbunden sind, die kompromittiert werden könnten und gescannt und gewartet werden. Diese Geräte werden für studentische, Forschungs- und Verwaltungsaufgaben verwendet. Diese Geräte weisen so genannte "Schwachstellen" auf, d. h. Schwachstellen, die Angreifer ausnutzen können. So könnte ein Host beispielsweise ein schwaches Passwort, eine Software mit veralteter Verschlüsselung oder eine Software ohne ausreichende Überprüfung der Größe von Ein- und Ausgaben verwenden. Diese Schwachstellen werden vom U.S. National Institute of Standards (NIST) und dem Common Vulnerability Scoring System bewertet.

Hier schlagen wir vor, die Daten und Annahmen für die Entwicklung von Wartungsrichtlinien auf diskrete Ereignissimulationen auszuweiten. Dies ähnelt dem von Gauci et al. (2017) behandelten Patch-Management in Stromversorgungsunternehmen, mit dem Unterschied, dass wir eine größere Anzahl vergangener Vorfälle und eine breitere Auswahl an Richtlinien und Host-Typen berücksichtigen. Zu den Vorteilen der diskreten Ereignissimulation gehören relativ intuitive Möglichkeiten, die Entstehung und Zerstörung von Hosts sowie endliche Patching- und Vorfallsreaktionsressourcen zu berücksichtigen. Wir sind der Meinung, dass die "End-of-Life"-Problematik von Hosts berücksichtigt werden muss, da wir anekdotisch von Hosts wissen, von denen wir annahmen, dass sie im Ruhestand sind, und die Vorfälle verursachen.

Unserer Erfahrung nach besteht eine gängige Richtlinie darin, dass die Mitarbeiter versuchen müssen, hochgradige oder kritische Schwachstellen innerhalb eines Monats nach dem Zeitpunkt, zu dem die Schwachstelle bei den monatlichen Scans festgestellt wurde, zu patchen oder zu entschärfen. Die Richtlinie ignoriert die Schwachstellen mittleren oder niedrigen Niveaus, die dazu neigen, sich zu häufen. Außerdem fehlten in der Regel 70 % der fast 50.000 untersuchten Hosts in einem bestimmten Monat bei den Scans. Dies kann darauf zurückzuführen sein, dass der Host während des Scans ausgeschaltet ist oder keine Berechtigungen vorhanden sind. Einige Methoden zur Berechnung der in den Scandaten fehlenden Schwachstellen werden von Afful-Dadzie und Allen (2014; 2016) beschrieben. Seit kurzem verfügen wir über Methoden, die mit hoher Genauigkeit (0,05 % Fehler) die Schwachstellen auf Hosts vorhersagen können, die in den monatlichen Scans nicht vorhanden ("dunkel") sind.

Hier betrachten wir die Auswirkungen von 21 Monaten beobachteter Übergänge von Monat zu Monat bei etwa 50.000 Hosts. Die daraus resultierenden Schätzungen der Übergangswahrscheinlichkeit sind in Tabelle 1 dargestellt. Die Wahrscheinlichkeiten spiegeln die kombinierten Auswirkungen von mindestens vier Faktoren wider. Erstens fügen die Benutzer der Hosts ständig neue Software hinzu, und die bereits hinzugefügte Software ist veraltet. Zweitens sind Hacker ständig auf der Suche nach Schwachstellen, beobachten die Bestätigung von öffentlich gemeldeten Schwachstellen und beschaffen sich Exploits (die oft auch frei veröffentlicht werden). Drittens versuchen die Hersteller ständig, ihre Software aus der Ferne automatisch zu patchen. Viertens versuchen die Mitarbeiter, Schwachstellen gemäß den Unternehmensrichtlinien mit Hilfe von Listen von Schwachstellen aus Scans und den Ergebnissen ihrer eigenen Suche nach verfügbaren Patches zu patchen, die erhaltenen Patches daraufhin zu testen, ob sie die Funktionalität nicht zerstören, und die gefundenen und getesteten Patches (falls vorhanden) anzuwenden.

Auch hier betrachten wir nur zwei Arten von Hosts. Dabei handelt es sich um Linux- und Windows-Hosts, bei denen der Benutzer über Administratorrechte zur Installation neuer Software verfügt und der Host nicht von Administratoren kontrolliert wird. (Kontrollierte Hosts sind im Allgemeinen viel sicherer.) Wir bezeichnen hier die übliche Wartungspolitik, bei der dunkle Hosts ignoriert werden, als "Out-of-Site is Out-of-Mind" (OSOM). Ein Hauptziel dieses Artikels ist es, die Probleme mit der OSOM-Richtlinie und die möglichen Vorteile von ausgefeilteren Richtlinien zu klären.

Tabelle 1: Geschätzte Übergangsdaten von einer großen Universität (a) Linux-Hosts, (b) geänderte Übergänge aufgrund verbesserter Informatik, (c) Windows-Hosts und (d) Änderungen aufgrund verbesserter Informatik.

(a)

| Niedrig-Med. | Niedrig-Med.-Dunkel | Hoch-Kritisch. | Hoch-Kritisch-Dunkel | Komp. | Komp.-Dunkel | |

|---|---|---|---|---|---|---|

| Niedrig-Med. | 0.2820 | 0.6580 | 0.0177 | 0.0413 | 0.0005 | 0.0005 |

| Niedrig-mittel-dunkel | 0.2820 | 0.6580 | 0.0177 | 0.0413 | 0.0005 | 0.0005 |

| Hoch-kritisch. | 0.1290 | 0.3010 | 0.1560 | 0.3640 | 0.0250 | 0.0250 |

| Hoch-Kritisch-Dunkel | 0.0000 | 0.0000 | 0.2250 | 0.7000 | 0.0250 | 0.0500 |

| Komp. | 1.0000 | 0.0000 | 0.0000 | 0.0000 | 0.0000 | 0.0000 |

| Komp.-Dunkel | 0.0000 | 0.0000 | 0.0000 | 0.0000 | 0.8000 | 0.2000 |

| (b) | ||||||

| Hoch-Kritisch-Dunkel | 0.1290 | 0.3010 | 0.1560 | 0.3640 | 0.0250 | 0.0250 |

(c)

| Niedrig-Med. | Niedrig-Med.-Dunkel | Hoch-Krit. | Hoch-Kritisch-Dunkel | Komp. | Komp.-Dunkel | |

|---|---|---|---|---|---|---|

| Niedrig-Med. | 0.2760 | 0.6440 | 0.0239 | 0.0559 | 0.0001 | 0.0001 |

| Niedrig-mittel-dunkel | 0.2760 | 0.6440 | 0.0239 | 0.0559 | 0.0001 | 0.0001 |

| Hoch-kritisch. | 0.1444 | 0.3369 | 0.1554 | 0.3627 | 0.0003 | 0.0003 |

| Hoch-Kritisch-Dunkel | 0.0000 | 0.0000 | 0.2988 | 0.7000 | 0.0006 | 0.0006 |

| Komp. | 1.0000 | 0.0000 | 0.0000 | 0.0000 | 0.0000 | 0.0000 |

| Komp.-Dunkel | 0.0000 | 0.0000 | 0.0000 | 0.0000 | 0.8000 | 0.2000 |

| (d) | ||||||

| Hoch-Kritisch-Dunkel | 0.1444 | 0.3369 | 0.1554 | 0.3627 | 0.0003 | 0.0003 |

Der vorgeschlagene Modus

Größe der Einheiten und Zeitspanne

Unser diskretes Ereignissimulationsmodell legt notwendigerweise die Anzahl der Server und Einheiten fest, die typischerweise im System vorhanden sind (Allen 2011; Law und Kelton 2000). Wir haben festgestellt, dass eine große Universität in der Regel als mehrere, weitgehend unabhängige Abteilungen mit jeweils typischerweise 100 Hosts organisiert ist. Jede Organisation hat einen Administrator, der hauptsächlich für die Behebung von Schwachstellen und die Erleichterung von Reaktionen auf bekannte Vorfälle zuständig ist. Daher umfasst das Modell etwas mehr als 100 Hosts (im Durchschnitt) über einen Zeitraum von mehr als 100 Jahren, um die Wartungs- und Reaktionskosten für eine Universität annähernd zu erfassen. Wie in AffulDadzie und Allen (2016) erwähnt, gehen wir davon aus, dass die Kosten für das Patchen von Schwachstellen im Durchschnitt 150 US-Dollar und die Reaktion auf bekannte Vorfälle im Durchschnitt 2.000 US-Dollar betragen. Daher werden die Auswirkungen von Schwachstellen gezählt, aber nur im Verhältnis zu den direkten Kosten für die rechtmäßige Behebung bekannter Vorfälle.

Staaten

In Anlehnung an Afful-Dadzie und Allen (2016) kategorisieren wir Hosts nach der Schwachstelle mit dem höchsten Risiko, d. h. ein Host mit einer kritischen Schwachstelle wird als kritisch eingestuft. In der gemeinsamen Strategie werden Hosts mit niedrigem und mittlerem Risiko im Allgemeinen ignoriert. Hosts können auch kompromittiert werden, z. B. wenn der Host über Malware verfügt, die versucht, den Hacker oder das Hacker-Team zu kontaktieren, aber vom Intrusion Prevention System abgefangen wird. Da einige Hosts im Scan "dunkel" sind und einige Eindringlinge nicht bekannt sind, berücksichtigen wir neben dem Zustand des zerstörten oder wiederhergestellten Hosts auch andere Zustände. Zu den Zuständen gehören sichtbare und dunkle Kombinationen von niedrig-mittel, hoch-kritisch und gefährdet. Gering und mittel sowie hoch und kritisch werden miteinander kombiniert, da sie in den Unternehmensrichtlinien oft als gleichwertig angesehen werden.

Es ist zu beachten, dass das Wissen um die Schwachstellen oder das Eindringen in das System nicht unbedingt den Zielen der Organisation dient. Dennoch ist die Beobachtbarkeit eindeutig eine wünschenswerte Eigenschaft von "widerstandsfähigen" Systemen (Allen et al. 2016). Ein Hauptziel dieses Artikels ist es, die möglichen Vorteile einer verbesserten Beobachtbarkeit zu verdeutlichen.

Die Lösung

SIMIO-Modell

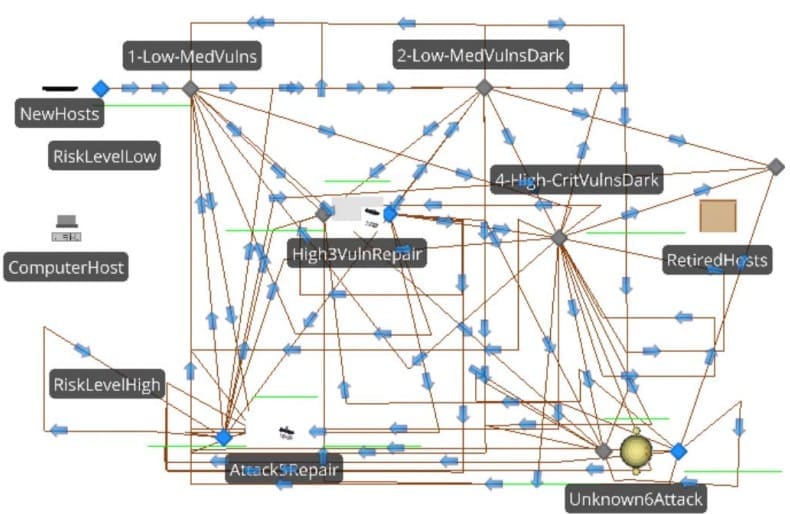

Das Modell ist in der SIMIO-Software implementiert. Der "NewHosts"-Knoten oben links in Abbildung 1 unten ist die Quelle mit den Hosts, die zum Knoten mit geringer bis mittlerer Anfälligkeit gehen, wo keine Verarbeitung stattfindet. Diese fehlende Verarbeitung (Erforschung, Prüfung und Anwendung von Patches, falls vorhanden) ist eine übliche Kosteneinsparungsmaßnahme, bei der gering bewertete Cyber-Schwachstellen ignoriert werden. Bis vor kurzem wurden wegen der Schwierigkeiten bei der Überprüfung alle nicht netzgebundenen Cyber-Schwachstellen auch von vielen Universitäten und anderen Organisationen weitgehend ignoriert. Daher werden sie auch hier ignoriert. Alle Pfade sind feste "Zeitpfade", die einem Monat entsprechen.

Die Gewichte sind proportional zu den Wahrscheinlichkeiten in Tabelle 1. Die Knoten, die nicht bearbeitet werden, entsprechen den Zuständen 1, 2 und 4. Die Server sind die Zustände 3, 5 und 6. Obwohl der dunkle kompromittierte Zustand keine Arbeit von den internen Mitarbeitern erfordert, wird ein Server verwendet, um kostenbezogene Informationen aus diesem Zustand zu erfassen. Rechts in Abbildung 1 befindet sich der Ausmusterungsknoten, in dem Hosts recycelt oder auf Deponien geschickt werden. Insgesamt werden Hosts auf der linken Seite erstellt und fließen auf der rechten Seite zur Zerstörung. Sie bewegen sich von sicheren Zuständen an der Spitze zu Verwundbarkeit und Kompromittierung an der Basis.

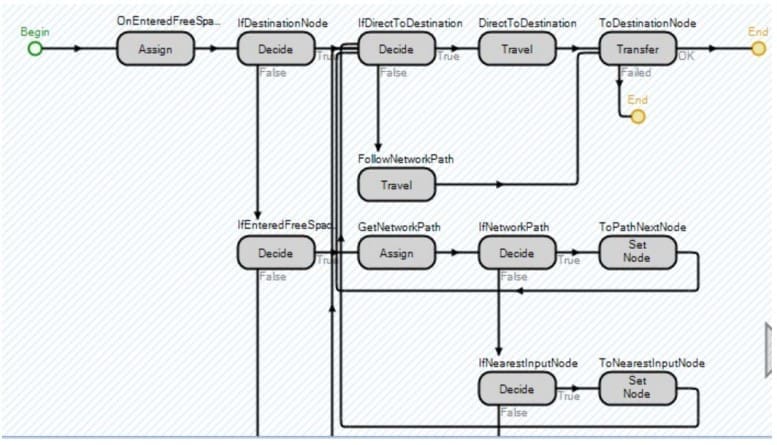

In der realen Welt befinden sich die Computer natürlich in Büros oder Cafés und werden nur minimal bewegt (mit Ausnahme von Laptops und Mobiltelefonen). Daher wird die übliche Logik der Bewegung von Hosts angewandt, wie in Abbildung 2 dargestellt. Die Hosts bewegen sich zu Beginn und am Ende ihres "Lebens", wenn sie auf einer Mülldeponie landen.

Die Hauptunterschiede zwischen dem Modell in Abbildung 1 und dem Markov-Entscheidungsprozess-Modell in Afful-Dadzie und Allen (2016) sind die Einbeziehung der Geburt und des Todes von Hosts hier und die relativ weniger gründliche Untersuchung der optimalen Strategien hier. Eine große Stärke von Markov-Entscheidungsprozessen ist die Fähigkeit, optimale Kontrollstrategien zu generieren. Die Qualität dieser "optimalen" Strategien wird jedoch durch die damit verbundenen Annahmen eingeschränkt. Außerdem werden unbekannte Angriffe hier im Simulationsmodell berücksichtigt und nicht vorher.

Die geschäftlichen Auswirkungen

Rohe Ergebnisse

Die Rohdaten von SIMIO sind in Tabelle 2 dargestellt. Bei den Ergebnissen werden 100 Replikationen verwendet, um die Halbwertsbreite des 95 %-Konfidenzintervalls auf weniger als 1 % der geschätzten Mengen zu begrenzen. Die Ergebnisse enthalten "H3VRStation1", um zu verdeutlichen, dass sie nur die Besuche an der sichtbaren Reparaturstation berücksichtigen und nicht die dunklen oder unbekannten Schwachstellen. Diese hypothetischen Kosten werden in den Ableitungen der Output-Analyse hinzugefügt, so dass sie sich nicht direkt aus den Simulationen ergeben. Linux-Szenarien abgeleitet aus Tabelle 1(a) und (b) Wahrscheinlichkeiten und Windows abgeleitet aus Tabelle 1(c) und (d) Wahrscheinlichkeiten.

Die Ergebnisse in Tabelle 2 beziehen sich auf die Anzahl der Hosts, die jeden Knoten besuchen. Der Besuch eines Reparatur- oder Störungsknotens führt direkt zu Kosten, da ein Mitarbeiter versuchen muss, die entsprechenden Sicherheitslücken zu schließen oder auf relevante Störungen zu reagieren. Die Kosten des Szenarios belaufen sich daher auf $150 × (Avg. #Repairs) + $2.000 × (Avg. #Incidents).

Tabelle 2: SIMIO-Rohdaten aus 100 Replikationen für die Anzahl der Ankünfte an den drei wichtigsten Stationen und die damit verbundenen erwarteten oder durchschnittlichen Kosten. Die vier "Schlüsselobjekte" oder Server sind "Active5Repair" (A5R), "High3VulnRepair" (H3VR) und "Unknown6Attack" (U6A).

| Szenario | Objekt Name | Durchschnittliche # | Halbe Breite | Stdev. | Exp. Kosten | Stdev. | Scen. Summen |

|---|---|---|---|---|---|---|---|

| Linux | A5R | 1241.5 | 8.2 | 40.8 | $2,482,980 | 81,557 | - |

| Linux | H3VR | 6915.9 | 30.7 | 152.8 | $1,037,387 | 22,927 | - |

| Linux | U6A | 1529.4 | 11.1 | 55.4 | $3,058,860 | 110,719 | $6,579,227 |

| Linux Nein D. | A5R | 1051.4 | 6.7 | 33.4 | $2,102,700 | 66,825 | - |

| Linux Nein D. | H3VRStation1 | 5733.1 | 25.7 | 127.6 | $2,866,565 | 63,808 | - |

| Linux Nein D. | U6A | 1201.5 | 8.4 | 41.7 | $2,402,920 | 83,436 | $7,372,185 |

| Fenster | A5R | 114.8 | 2.3 | 11.3 | $229,660 | 22,511 | - |

| Windows | H3VR | 8528.2 | 33.8 | 168.0 | $1,279,229 | 25,198 | - |

| Fenster | U6A | 69.0 | 2.1 | 10.6 | $137,980 | 21,133 | $1,646,869 |

| Fenster Nein D. | A5R | 90.5 | 2.0 | 10.0 | $180,920 | 20,049 | - |

| Windows Nein D. | H3VRStation1 | 5902.8 | 25.4 | 126.3 | $2,951,415 | 63,139 | - |

| Fenster Nr. D. | U6A | 46.5 | 1.5 | 7.6 | $93,080 | 15,102 | $3,225,415 |

| Linux Keine Dunkelheit | H3VRStation1 | 5733.1 | 25.7 | 127.6 | $2,866,565 | 63,808 | $7,372,185 |

| Windows Hypoth. | H3VRStation1 | 5902.8 | 25.4 | 126.3 | $2,951,415 | 63,139 | $864,283 |

Vergleich der Alternativen

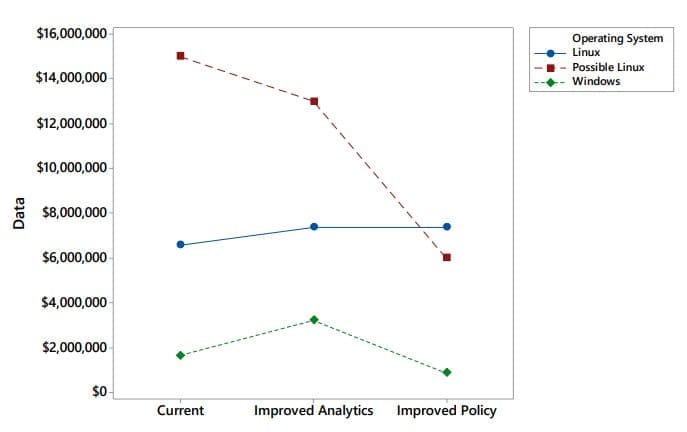

In Abbildung 3 werden sechs Systeme in Bezug auf die voraussichtlichen Kosten verglichen. Die Ergebnisse für die aktuellen Linux- und Windows-Systeme ergeben sich direkt aus der Simulation mit den Eingaben in Tabelle 1 und den Ergebnissen in Tabelle 2. Die so genannte "verbesserte Analytik"-Politik für jedes System bezieht sich einfach auf die Wahrscheinlichkeiten oder Gewichte aus Tabelle 1(b) bzw. Tabelle 1(d) für die Betriebssysteme Linux und Windows. Diese Änderungen bedeuten, dass der Zustand 4 dem Zustand 3 in Bezug auf die Leistung entspricht, so dass zusätzliche Patching-Vorgänge stattfinden würden. Mit anderen Worten, die versteckten Schwachstellen werden aufgedeckt. Dies führte zu den 1/0,3-fachen Kosten des Servers im Zustand 3 (A3VR).

Die Schätzungen für das "mögliche Linux"-System beruhen auf der Befragung eines Experten. Mit Hilfe von Fragen, was zu erwarten wäre und was plausibelerweise zu hoch oder zu niedrig wäre, wurden Schätzungen ermittelt, die die Kosten unbekannter Vorfälle durch einen marketingähnlichen Erhebungsprozess angemessen berücksichtigen (Allen und Maybin 2004). Die möglichen Linux-Ergebnisse sollen die Vorteile widerspiegeln, die sich aus der Kenntnis der Schwachstellen auf Dark Hosts ergeben.

Die Schätzungen für die verbesserten Richtlinien basieren auf den wahrscheinlichen Ergebnissen, die eintreten könnten, wenn nur kritische Sicherheitslücken (1/5 der Sicherheitslücken oder weniger) auf Windows-Systemen gepatcht würden. Unsere Analysen von Markov-Entscheidungsprozessen deuten darauf hin, dass das Patchen hoher Schwachstellen auf bestimmten Arten von Windows-Systemen aufgrund des intensiven automatischen Patchings nicht kosteneffizient ist (Afful-Dadzie und Allen 2016). Dennoch würde das Patchen kritischer Schwachstellen auf Dark Hosts mit ziemlicher Sicherheit Vorteile mit sich bringen. Daher beziehen sich einige der Ergebnisse in Abbildung 3 auf Simulationsergebnisse und andere sind Schätzungen aus ermittelten Expertenmeinungen.

Schlussfolgerungen und zukünftige Arbeiten

In diesem Artikel wird ein diskretes Ereignissimulationsmodell zur Vorhersage der Kosten für Flickarbeiten und Zwischenfälle vorgeschlagen. Die Modelle beruhen auf Hunderttausenden von aufgezeichneten Übergängen. Es gibt jedoch auch beträchtliche Extrapolationen, einschließlich der effektiven Kosten verbesserter Maßnahmen oder von Verlusten einschließlich unbekannter Vorfälle. Mit diesen Einschränkungen ergeben sich die folgenden Erkenntnisse:

- Windows-Hosts erfordern in unserem Datensatz und den Simulationsvorhersagen wesentlich geringere Wartungskosten als Linux-Hosts. Dies setzt voraus, dass die Host-Besitzer über Administratorrechte verfügen, was den Betrieb dieser Hosts relativ riskant macht. Die von Microsoft durchgeführten strengen automatischen Patches sind jedoch wahrscheinlich mit geringeren Wartungskosten verbunden.

- Die Sichtbarmachung dunkler Windows-Hosts mit verbesserten Analysen scheint nicht kostengerecht zu sein. Dies liegt daran, dass die Kosten für den Umgang mit den wahrscheinlich 70 % der Schwachstellen, die durch die "Out-of-site is out-of-mind"-Richtlinie ignoriert werden, nicht durch die Verringerung der bekannten Vorfälle ausgeglichen würden. Wenn jedoch die Verluste für die Allgemeinheit genau abgeschätzt werden könnten, dann könnten die geringeren Vorfälle durch das Patchen der unbekannten Schwachstellen kompensiert werden.

- Die Sichtbarmachung dunkler Linux-Hosts mit verbesserter Analytik ist in etwa kostendeckend und würde dem System wahrscheinlich zu mehr Widerstandsfähigkeit und gesellschaftlichem Nutzen verhelfen.

- Die Sichtbarmachung dunkler Hosts aller Art ist wahrscheinlich kostenmäßig gerechtfertigt, wenn die verbesserte Analyse mit einer verbesserten Strategie kombiniert wird. So könnten beispielsweise bei Windows-Hosts viele oder alle Sicherheitslücken ignoriert werden, da viele davon durch automatisches Patchen behoben werden.

Die wichtigsten Einschränkungen des vorgeschlagenen Modells beziehen sich auf nicht unterstützte Funktionen. Multi-Fidelity-Metamodelle könnten eine bessere Vorhersagefähigkeit bieten (z. B. unter Verwendung der Planungs- und Analysemethoden in Allen und Bernstheyn 2005 oder Allen et al. 2003). Die Konzepte der partiellen Beobachtbarkeit und der begrenzten Beobachtungen können nützliche Wartungsempfehlungen hervorbringen. Außerdem können automatische Kontrollsysteme auf der Grundlage des Bayes'schen Verstärkungslernens eingesetzt werden, um Instandhaltungs- und Störungsreaktionsmaßnahmen zu steuern, die Daten optimal rekrutieren und Datenbeschränkungen berücksichtigen.

Danksagung

Wir danken LTC Cade Saie und NSF Grant # 1409214 für die finanzielle Unterstützung sowie Helen Patton, Steven Romig und Rajiv Ramnath für die allgemeine Unterstützung dieser und verwandter Forschungsarbeiten.

Biografien der Autoren

THEODORE T. ALLEN ist außerordentlicher Professor in der Abteilung für integrierte Systemtechnik an der Ohio State University. Er erhielt seinen B.A. von Princeton, seinen M.S. von UCLA und seinen Ph.D. von der University of Michigan (1997). Derzeit ist er Vorsitzender der Sektion Social Media Analytics von INFORMS und Redakteur für den Bereich Simulation in Computers & Industrial Engineering (IF: 3.2). Er hat über 60 begutachtete Publikationen veröffentlicht und über 25 Zuschüsse als PI erhalten, darunter von NSF, ARCYBER und GE Appliances. Seine Forschungen zur Simulationsoptimierung für die Zuweisung von Wahlgeräten haben landesweit Beachtung gefunden, und er hat dazu beigetragen, dass Millionen von Wählern stundenlange Wartezeiten und effektive oder tatsächliche Gesetzesänderungen in North Carolina, Ohio und Michigan vermeiden konnten. Er war außerdem Mitherausgeber der Zeitschriften Journal of Manufacturing Systems und Quality Approaches in Education sowie Gutachter für Operations Research, Technometrics und viele andere Zeitschriften (allen.515@osu.edu).

ENHAO LIU ist Doktorand in der Abteilung Integrated Systems Engineering an der Ohio State University. Er erhielt seinen M.S. von der Ohio State University (2017) und seinen B.S. von der Jinan University in Electrical Engineering and Automation (2015). Seine Interessen liegen in den Bereichen Cybersicherheit, Operations Research und Zuverlässigkeitstechnik (liu.5045@osu.edu).

Referenzen

Afful-Dadzie, A. und T. T. Allen. 2014. Data-driven Cyber-Vulnerability Maintenance Policies. Journal of Quality Technology 46(3):234.

Afful-Dadzie, A. und T. T. Allen. 2016. "Control Charting Methods for Autocorrelated Cyber Vulnerability Data". Quality Engineering 28(3):313-28.

Allen, T. T., 2011. Einführung in die diskrete Ereignissimulation und agentenbasierte Modellierung: Voting Systems, Health Care, Military, and Manufacturing. London: Springer Science & Business Media.

Allen, T. und M. Bernshteyn. 2006. "Abmilderung der Wartezeiten für Wähler". Chance 19(4):25-34.

Allen, T. T. K. M. und Maybin. 2004. "Verwendung von Fokusgruppendaten zur Festlegung von Preisen für neue Produkte". Zeitschrift für Produkt- und Markenmanagement 13(1):15-24.

Allen, T. T., L. Yu, und J. Schmitz. 2003. "An Experimental Design Criterion for Minimizing Meta-model Prediction Errors Applied to Die Casting Process Design". Zeitschrift der Königlichen Statistischen Gesellschaft: Series C (Applied Statistics), 52(1):103-117.

Allen, T. T., J. Schenk, und D. D. Woods. 2016. "An Initial Comparison of Selected Models of System Resilience". In Resilience Engineering Perspectives, herausgegeben von E. Hollnagel und C. Nemeth, Band 2, 95-116. London: CRC Press.

Case, D. U. 2016. "Analysis of the Cyber Attack on the Ukrainian Power Grid". Washington, DC: Electricity Information Sharing and Analysis Center (E-ISAC).

Gauci A., S. Michelin, und M. Salles. 2017. "Addressing the Challenge of Cyber Security Maintenance Through Patch Management". CIRED-Open Access Proceedings Journal (1):2599-2601.

Naugle, A., M. Bernard, and I. V. Lochard. 2016. "Simulating Political and Attack Dynamics of the 2007 Estonian Cyber Attacks". In Proceedings of the 2016 Winter Simulation Conference, edited by T.M. K. Roeder et al., 3500-3509. Piscataway, New Jersey: IEEE.

Nguyen, C. K. Q., J. E. Dietz, S. Liles, V. Raskin, und J. Springer. 2015. "Cyber Defense Econometric of a Power Grid Distribution Infrastructure". In Proceedings of the 2015 Winter Simulation Conference, edited by L. Yilmaz et al., 906-911. Piscataway, New Jersey: IEEE.

Huang, D. und T. T. Allen. 2005. "Design and Analysis of Variable Fidelity Experimentation Applied to Engine Valve Heat Treatment Process Design". Zeitschrift der Königlichen Statistischen Gesellschaft: Series C (Applied Statistics) 54(2):443-463.

Law, A. M. und W. D. Kelton. 2000. Simulation, Modellierung und Analyse. 3rd ed. New York: McGraw-Hill. Shin J., H. Son, and G. Heo. 2015. "Development of a Cyber Security Risk Model using Bayesian Networks". Reliability Engineering & System Safety 134:208-217.

Applications

- Optimierung des Flottenwachstums durch Simulation: Der Weg von Penske Truck Leasing zur Kapazitätsplanung

- Optimierung der Produktionsplanung in der Fertigung durch intelligente digitale Zwillinge

- Fertigungssimulationssoftware: Wie Northrop Grumman seine Modellierungsfähigkeiten mit Simio erweitert hat

- Wie Dijitalis durch AGV-Optimierungssimulationen in der Elektronikfertigung 1,5 Millionen Dollar einsparen konnte